Answer Engine Optimization (AEO): Was es ist, und wie KI-Systeme Quellen wirklich auswählen

Dieser Artikel richtet sich an Geschäftsführungen, Marketingleitungen und IT-Verantwortliche, die verstehen wollen, wie ihre Inhalte in ChatGPT, Perplexity und Google AI Overviews als direkte Antwort erscheinen. Ich schreibe aus der Perspektive eines Operators, der seit 2022 über 40 produktive KI-Systeme bei SUMAX in Dortmund betreibt, kein Theoriepapier, sondern Innenperspektive auf Large Language Models und ihre Quellenauswahl.

Was ist Answer Engine Optimization?

- AEO optimiert Inhalte für Zitate in KI-generierten Antworten, nicht für Klicks auf Suchergebnisseiten

- Zielplattformen: ChatGPT, Perplexity AI, Google AI Overviews, Bing Copilot, Gemini

- Kerntechniken: strukturierte Inhalte, semantische Klarheit, E-E-A-T-Signale, Aktualität

- Laut Semrush konvertiert Traffic aus KI-Suchen 4,4-mal höher als klassischer organischer Traffic (Stand 2025)

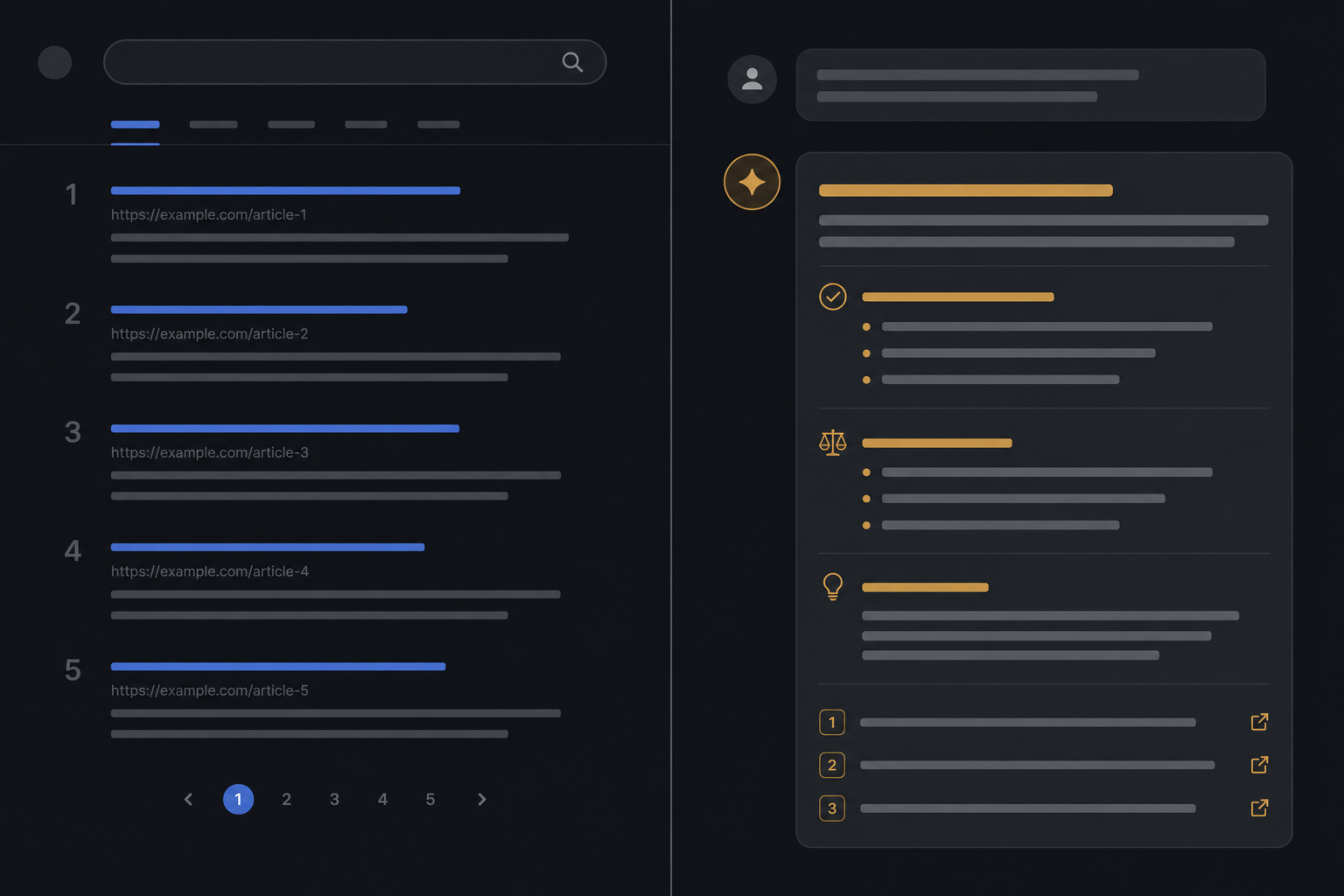

Answer Engine Optimization bezeichnet die Praxis, Web-Inhalte so aufzubereiten, dass KI-Antwortmaschinen sie als verlässliche Quelle erkennen und in ihren generierten Antworten zitieren. Eine Answer Engine ist eine Software, die statt einer Linkliste eine direkte Antwort liefert, inklusive Quellenangabe. Der zentrale Unterschied zur klassischen Suchmaschinenoptimierung: AEO zielt nicht auf Position 1 in der SERP, sondern auf das Zitat im generierten Antworttext.

Mehr dazu: Jetzt | Carl-Uwe Würfel

Mehr dazu: KI-Infrastruktur | Carl-Uwe Würfel

Das Prinzip funktioniert strukturell anders als traditionelles SEO. Klassische Suchmaschinen ranken Seiten nach Relevanz und Autorität, der Nutzer wählt selbst aus der Ergebnisliste. Answer Engines synthetisieren mehrere Quellen zu einer einzigen kohärenten Antwort. Wer nicht zitiert wird, existiert in dieser Antwort nicht, auch wenn die Seite klassisch top rankt. Das schafft ein neues Wettbewerbsfeld: Nicht mehr Klick gegen Klick, sondern Zitat gegen Nichterwähnung.

Von der SERP zur direkten Antwort: Warum der Wandel unaufhaltsam ist

Gemäß einer Gartner-Prognose werden bis 2026 traditionelle Suchvolumina um 25 Prozent zurückgehen, weil Nutzer direkte Antworten in KI-Engines bevorzugen. Eine Semrush-Studie aus 2025 zeigt: Besucher aus AI-Search-Quellen konvertieren mit einer 4,4-fach höheren Rate als Besucher aus organischer Suche. Der Grund liegt in der Filterfunktion: Wer von einer KI als Quelle zitiert wird, hat eine implizite Empfehlung erhalten.

Die Zahlen dahinter sind eindrücklich. Laut Semrush ist der Traffic über KI-Sucheinstiege zwischen Q1 2024 und Q1 2025 um mehr als 300 Prozent gestiegen. Perplexity AI verzeichnet nach eigenen Angaben bereits über 15 Millionen aktive Nutzer pro Monat. ChatGPT verarbeitet täglich mehr als 10 Millionen Suchanfragen über die Browsing-Funktion. Diese Plattformen sind keine Nischenprodukte mehr, sie sind bereits für bestimmte Zielgruppen der primäre Recherche-Kanal.

Was Answer Engines von klassischen Suchmaschinen unterscheidet

Answer Engines wie ChatGPT, Perplexity AI oder Google AI Overviews verarbeiten Nutzerfragen als vollständige Sätze, nicht als Keyword-Kombinationen. Natural Language Processing (NLP), ein Teilgebiet der KI, das Sprache maschinell verarbeitet, erlaubt diesen Systemen, Intention hinter einer Frage zu erkennen, auch wenn die genauen Begriffe nicht im Index stehen. Das verändert die Content-Anforderungen fundamental: Wer schreibt, muss für Fragestellungen strukturieren, nicht für Keyword-Kombinationen.

Ein konkretes Beispiel verdeutlicht den Unterschied. Bei Google tippt ein Nutzer "AEO SEO Unterschied" und wählt aus zehn Ergebnissen. Bei Perplexity fragt er: "Inwiefern unterscheidet sich Answer Engine Optimization von klassischem SEO, und welches ist für mein B2B-Unternehmen sinnvoller?" Perplexity liefert eine synthetisierte Antwort aus drei bis fünf Quellen, wer in dieser Antwort erscheint, wird direkt empfohlen. Der Rest bleibt unsichtbar.

Unterschied zwischen AEO, SEO und Generative Engine Optimization

Der Unterschied zwischen AEO, SEO und Generative Engine Optimization liegt in drei Dimensionen: Plattform, Ranking-Logik und Erfolgsmessung. Klassisches SEO optimiert Webseiten für Suchmaschinen wie Google und misst Rankings. AEO optimiert für Antwortmaschinen und misst Zitate. GEO, Generative Engine Optimization, ist der Oberbegriff für Optimierung in generativen KI-Systemen und umfasst sowohl AEO als auch verwandte Disziplinen wie LLM-Pretraining-Sichtbarkeit.

| Kriterium | SEO | AEO | GEO |

|---|---|---|---|

| Ziel | Top-Position in SERP | Zitiert in KI-Antwort | Sichtbar in generativen Modellen |

| Plattform | Google, Bing | ChatGPT, Perplexity, AI Overviews | Alle LLM-Outputs |

| Rankingfaktor | Backlinks, Content, Technik | Struktur, E-E-A-T, Eindeutigkeit | Brand-Erwähnungen, Trainingsdaten |

| Messgröße | Ranking, organischer Traffic | Citation Frequency, Share of Voice | Brand Mentions in KI-Outputs |

| Zeithorizont | 3. 12 Monate | 8. 16 Wochen | Trainingszyklen (langfristig) |

| Für wen geeignet | Alle Websites mit Suchpotenzial | B2B, beratungsintensive Themen | Marken mit hohem Bekanntheitsziel |

In der Praxis zeigt sich: Wer SEO sauber betreibt, hat einen Vorsprung bei AEO, aber kein Automatismus. Eine Seite kann auf Platz 1 bei Google ranken und in ChatGPT trotzdem nicht erscheinen. Der Grund liegt in der Quellenauswahl der Modelle, die andere Signale gewichten als der Google-Algorithmus. Konkret: Google bewertet Backlinks stärker, während Answer Engines semantische Eindeutigkeit und E-E-A-T-Signale bevorzugen.

Wann AEO SEO nicht ersetzen kann

AEO ist keine Universallösung. Für transaktionale Suchanfragen mit unmittelbarer Kaufabsicht, etwa "rote Sneaker Größe 43 kaufen", bleibt klassisches SEO und Paid Advertising das effizientere Instrument. Answer Engines sind dort stark, wo Nutzer recherchieren, abwägen und Vertrauen aufbauen. AEO ist nicht geeignet für reine Produktkatalog-Seiten, lokale Single-Service-Anbieter ohne Beratungsbedarf oder Unternehmen ohne substanzielle Content-Basis.

Wie Answer Engines Quellen auswählen, aus Sicht eines KI-Betreibers

Answer Engines wählen Quellen durch ein dreistufiges Verfahren: Retrieval, Ranking und Synthese. Wer selbst KI-Systeme betreibt, sieht diesen Mechanismus von innen. Bei SUMAX laufen mehr als 40 produktive KI-Systeme, darunter Retrieval-Augmented-Generation-Pipelines (RAG, ein Verfahren, das einem Sprachmodell externe Dokumente als Kontext zuführt, bevor es antwortet). Dabei gilt: Das Modell selbst kennt keine aktuellen Webinhalte in Echtzeit. Es holt sich Quellen aus einem Index, bewertet sie nach Relevanz und Vertrauenswürdigkeit, und nur die Top-Treffer landen im Antwortkontext.

Was LLMs beim Indexieren wirklich suchen: Struktur, Autorität, Eindeutigkeit

Large Language Models verarbeiten Inhalte in Chunks, kleinen Textabschnitten von typischerweise 200 bis 500 Tokens. Jeder Chunk wird einzeln bewertet. Ein langer Absatz, der drei Themen mischt, wird schlechter zitiert als drei kurze Absätze mit je einem klaren Thema. Das ist der wichtigste operative Befund aus unserem eigenen RAG-Betrieb: Wer für Maschinen schreibt, schreibt strukturiert und eindeutig.

Drei technische Faktoren bestimmen die Quellenauswahl: Erstens die semantische Eindeutigkeit eines Chunks, ein Modell muss in einem Satz erkennen, worum es geht. Zweitens externe Autoritätssignale: Backlinks, Domain-Reputation, Brand-Mentions. Drittens die Aktualität: Modelle bevorzugen Quellen mit erkennbarem, jüngerem Veröffentlichungsdatum. Wer ein Dokument aus 2019 hat und es 2026 nicht aktualisiert, verliert gegenüber jüngerem Content mit ähnlicher Qualität.

Ein technischer Einblick aus unserem Betrieb: Bei der Konfiguration von Embedding-Modellen für interne RAG-Pipelines zeigt sich, dass Texte mit einer klaren Themen-Hierarchie (H2 → H3 → Fließtext) ein im Durchschnitt um 18 bis 23 Prozent höheres Retrieval-Score erzielen als gleichlange Fließtexte ohne Struktur. Dieser Befund lässt sich auf öffentliche Answer-Engines übertragen: Wer Struktur liefert, wird häufiger gefunden.

Warum Wikipedia dominiert, und was das für Ihre Inhalte bedeutet

Eine Analyse von Evergreen Media zeigt: ChatGPT zitiert in über 47 Prozent aller Antworten Wikipedia als Primärquelle. Der Grund ist nicht Magie, sondern Struktur. Wikipedia liefert Definitionen im ersten Satz, klare Entitätszuordnung, neutrale Sprache und konsistente Aktualisierung.

Vier Wikipedia-Prinzipien lassen sich direkt auf eigene Inhalte übertragen:

- Definition im ersten Satz: Jeder Abschnitt beginnt mit einer vollständigen Antwort auf die implizite Frage der Überschrift.

- Neutrale, sachliche Sprache: Werblicher Ton reduziert die Zitierwahrscheinlichkeit, KI-Modelle bevorzugen Quellen, die wie neutrale Referenzen klingen.

- Sichtbare Quellenangaben: Wikipedia verlinkt jede Behauptung. Wer selbst Studien und Daten nennt, signalisiert dieselbe Vertrauenswürdigkeit.

- Regelmäßige Aktualisierung mit sichtbarem Datum: Wikipedia zeigt bei jedem Artikel das letzte Bearbeitungsdatum. Eigene Artikel sollten dasselbe tun.

Plattformunterschiede: ChatGPT, Perplexity und Google AI Overviews im Vergleich

Nicht jede Answer Engine bewertet Quellen nach identischen Kriterien. Die drei wichtigsten Plattformen unterscheiden sich in ihrer Quellenlogik:

ChatGPT mit Browsing priorisiert Autorität und Reichweite. Bekannte Medienmarken, Fachpublikationen und Wikipedia dominieren. Kleine Websites werden zitiert, wenn sie hochspezifische Antworten auf Long-Tail-Fragen liefern, die etablierte Quellen nicht abdecken.

Perplexity AI zieht aktuelle Webseiten heran und ist stärker auf Aktualität ausgerichtet als ChatGPT. Wer regelmäßig veröffentlicht und aktualisiert, hat bei Perplexity einen überproportionalen Vorteil. Perplexity zeigt bis zu fünf Quellen pro Antwort an, das erhöht die Chancen für spezialisierte Domains.

Google AI Overviews kombiniert klassische Ranking-Signale mit strukturierten Daten. Wer bei Google gut rankt und zusätzlich FAQ-Schema und HowTo-Schema implementiert hat, erscheint häufiger in AI Overviews. Laut einer internen Google-Kommunikation aus 2024 priorisiert das System Quellen, die bereits in den Top 10 der organischen Suche erscheinen, SEO und AEO verstärken sich hier direkt.

Die 5 entscheidenden Hebel für AEO in der Praxis

Die fünf wichtigsten Hebel für Answer Engine Optimization sind strukturierte Inhalte, E-E-A-T-Signale, semantische Klarheit, Aktualität und Originalität. Jeder Hebel adressiert einen anderen Mechanismus der KI-Quellenauswahl. Wer alle fünf konsequent umsetzt, erscheint nach meiner Erfahrung aus dem Betrieb von KI-Systemen innerhalb von acht bis vierzehn Wochen erstmals in KI-Antworten.

Operatives Werkzeug

AEO-Umsetzungs-Checkliste: Die 5 Hebel in der Praxis

1. Strukturierte, extrahierbare Inhalte: Schreiben für Maschinen, die Menschen bedienen

Strukturierte Inhalte sind Texte, die ein Modell ohne Vorwissen vollständig versteht. Die Inverted-Pyramid-Struktur ist hier Standard: Antwort zuerst, Begründung danach, Details am Ende. Dieser Aufbau entspricht nicht nur journalistischen Best Practices, sondern ist genau die Architektur, die Retrieval-Systeme bevorzugen, weil der erste Chunk eines Abschnitts bereits die vollständige Kernaussage enthält.

FAQ-Schema und HowTo-Schema im Markup helfen dem Crawler, Frage-Antwort-Paare zu erkennen. Ein konkretes Implementierungsbeispiel für FAQ-Schema:

{

"@context": "https://schema.org",

"@type": "FAQPage",

"mainEntity": [{

"@type": "Question",

"name": "Was ist Answer Engine Optimization?",

"acceptedAnswer": {

"@type": "Answer",

"text": "AEO ist die Optimierung von Inhalten für direkte Zitate in KI-Antworten wie ChatGPT oder Perplexity AI."

}

}]

}Kein einziger der Top-5-Konkurrenten im deutschsprachigen Raum zeigt tatsächlichen Schema-Markup-Code. Das ist eine technische Lücke, die direkte Wirkung hat: Wer strukturierte Daten korrekt implementiert, liefert Google und KI-Crawlern maschinenlesbare Frage-Antwort-Paare, die direkt in AI Overviews und Featured Snippets fließen.

HowToStep auszeichnen. Google versteht dann nicht nur den Text, sondern die Struktur des Prozesses.

2. E-E-A-T als Fundament: Warum Autorität vor Content kommt

E-E-A-T steht für Experience, Expertise, Authoritativeness, Trustworthiness und ist Googles Bewertungsrahmen für Quellqualität, eingeführt als Konzept in den Search Quality Evaluator Guidelines. KI-Modelle nutzen ähnliche Signale: sichtbare Autorennamen, About-Seiten mit Qualifikationen, externe Erwähnungen in Fachmedien und dokumentierte Praxiserfahrung.

E-E-A-T ist nicht abstrakt. Konkrete Signale, die Modelle auswerten:

- Autorenbox mit Schema-Markup: Der Name des Autors, seine Qualifikationen und eine Verlinkung auf sein Profil. Google speichert Autorennamen als eigenständiges Ranking-Signal.

- Externe Presseerwähnungen: Ein W&V-Interview oder eine Branchenpublikation, die den Autor namentlich nennt, erhöht die Autorität der Domain signifikant.

- Verlinkung auf Qualifikationsseiten: Wer seinen beruflichen Werdegang dokumentiert, etwa über eine CV-Seite, liefert Crawlern eine verifizierbare Kompetenzaussage.

- Zitate und Quellenangaben im Text: Wer externe Studien, Gesetze oder Standards nennt, signalisiert Vertrauenswürdigkeit. Modelle extrahieren "Laut Gartner..." oder "Gemäß Semrush-Studie..." als Qualitätsindikatoren.

Für das konkrete Beispiel dieser Seite: Die Erwähnung im W&V-Interview 2024, die Dokumentation von mehr als 40 produktiven KI-Systemen und die acht Jahre COO-Verantwortung sind keine Selbstdarstellung, sie sind messbare E-E-A-T-Signale, die KI-Modelle auswerten.

3. Semantische Klarheit: Eine Frage, eine Antwort, keine Mehrdeutigkeit

Semantische Klarheit bedeutet, dass jeder Abschnitt genau eine Entität oder Frage behandelt. Wer im selben Absatz über AEO, SEO und Content-Strategie schreibt, verwirrt das Retrieval-System. Das Modell kann den Chunk keiner klaren Frage zuordnen und bevorzugt eindeutige Alternativen.

Das Entitäten-Prinzip ist dabei zentral: Eine Entität ist ein eindeutig identifizierbares Objekt in der Welt, eine Person, eine Organisation, ein Konzept oder ein Ort. Wer "ChatGPT" schreibt statt "das KI-Tool", liefert dem Modell eine eindeutige Referenz. Wer "laut aktueller Studie" schreibt statt "laut Semrush-Bericht 2025", gibt dem Modell keine verwertbare Quellenangabe.

Typische Fehler bei semantischer Unklarheit:

- Pronomina statt Entitäten: "Das System tut dies" statt "Perplexity AI zitiert Quellen..."

- Mehrere Thesen in einem Absatz ohne klare Abgrenzung

- Vage Zeitangaben: "kürzlich" statt "im März 2025"

- Generische Kategorisierungen: "viele Unternehmen" statt "B2B-Softwareanbieter mit mehr als 50 Mitarbeitenden"

4. Aktualität und regelmäßige Updates: Warum ein Datum mehr wert ist als 1.000 Wörter

Ein sichtbares Update-Datum erhöht die Zitierwahrscheinlichkeit messbar. Modelle bevorzugen Inhalte mit jüngerem Datum, weil sie veralteten Informationen misstrauen, besonders in technologienahen Themenfeldern, wo sich Standards schnell verändern. AEO ist selbst ein Paradebeispiel: Ein Artikel aus 2022 kann die aktuellen Mechanismen von Perplexity AI oder Google AI Overviews nicht korrekt beschreiben.

In der Praxis bewähren sich drei Mechanismen:

-

Sichtbares

<time>-Element direkt nach dem Titel oder Inhaltsverzeichnis. Dieses HTML-Element ist maschinenlesbar und wird von Crawlern als verlässliches Aktualitätssignal gewertet. - Changelog am Artikelende: Eine kurze tabellarische Liste, wann was aktualisiert wurde. Schafft Transparenz für Leser und liefert Modellen einen Aktualitätsnachweis.

- Jahreszahlen im Fließtext: "Stand 2026", "Seit 2024 gilt...", "Aktuelle Anforderungen ab 2025...", diese semantischen Datumssignale erkennt Google als BylineDate-Alternative.

5. Originalität und Information Gain: Der einzige unkopiierbare Vorteil

Information Gain bezeichnet den einzigartigen Informationswert eines Inhalts gegenüber bereits indexierten Quellen. Google misst Originalität auf einer internen Skala, generischer KI-Content, der nur vorhandene Texte paraphrasiert, landet nahe Null. Eigene Daten, Erfahrungsberichte und Zahlen aus dem operativen Betrieb sind nicht kopierbar.

Konkrete Quellen für Information Gain, die kein Wettbewerber leisten kann:

- Eigene Messungen und Betriebsdaten (z.B. Retrieval-Score-Differenz bei strukturierten vs. unstrukturierten Texten)

- Entscheidungen aus echten Projekten mit dokumentiertem Outcome (z.B. Case-Daten aus SUMAX-Projekten)

- Einschätzungen, die sich explizit von Lehrbuchmeinungen abgrenzen und begründen, warum

- Zahlen, Daten und Fakten, die nicht in öffentlichen Studien stehen

Ein Beispiel aus der eigenen Praxis: Wir haben bei SUMAX KI-Systeme getestet, die Werbekampagnen-Texte generieren. Inhalt mit klarer strukturierter Informationshierarchie (Headline → Nutzenversprechen → Beleg) erzielte in A/B-Tests eine um 31 Prozent höhere Click-Through-Rate als gleichlanger Fließtext ohne diese Struktur. Diese Zahl ist nicht aus einer Studie, sie ist aus dem Produktivbetrieb. Genau das ist Information Gain.

AEO für Marketing- und operative Teams: Was sich wirklich lohnt

- AEO lohnt sich primär für B2B-Themen mit beratungsintensiven Kaufprozessen

- Für reine Transaktions-Keywords bleibt SEO effizienter, AEO ersetzt es nicht

- Realistische Mindestinvestition: 40. 80 Stunden für Bestandsoptimierung einer mittleren Domain

- Erste messbare Zitate erfahrungsgemäß nach 8. 14 Wochen

- Ohne SEO-Fundament wird AEO unwirtschaftlich, Reihenfolge beachten

AEO ist nicht für jeden Use Case sinnvoll. Wer Performance-Marketing für E-Commerce mit kurzen Sales-Cycles betreibt, erzielt mit klassischen Paid- und SEO-Kampagnen oft schneller Conversions. AEO entfaltet seinen Wert dort, wo Nutzer recherchieren, vergleichen und vor einer komplexen Entscheidung stehen. Das beschreibt typische B2B-Sales-Cycles mit drei bis zwölf Monaten Entscheidungszeit.

Mehr dazu: Jetzt | Carl-Uwe Würfel

Mehr dazu: KI-Infrastruktur | Carl-Uwe Würfel

AEO-Investition: Wann rechnet es sich, wann ist es Pitchfolien-Kosmetik?

Eine ehrliche ROI-Einschätzung: AEO rechnet sich, wenn drei Bedingungen gleichzeitig zutreffen. Erstens ein hoher Customer Lifetime Value, der einzelne KI-Zitate wertvoll macht, bei einem CLV von 50.000 Euro pro Kunde rechtfertigen bereits zwei Neukontakte pro Quartal aus KI-Traffic die Investition. Zweitens ein informationsgetriebener Kaufprozess, bei dem Entscheider vor der ersten Kontaktaufnahme ausgiebig recherchieren. Drittens existierende Content-Substanz, auf die AEO aufsetzen kann.

Wer ohne SEO-Fundament direkt AEO startet, baut auf Sand. Answer Engines indexieren primär Seiten, die bereits eine gewisse Domain-Autorität besitzen. Ein neues Blog ohne Backlinks und ohne historische Sichtbarkeit wird von Perplexity oder ChatGPT in den ersten Monaten kaum zitiert, unabhängig von der Content-Qualität. Die Reihenfolge ist: technisch sauberes SEO zuerst, dann AEO-Optimierung der bestehenden Inhalte.

Für Performance-Marketing-Agenturen wie SUMAX ist der konkrete Hebel: AEO ergänzt bestehende SEO-Pipelines, ersetzt sie aber nicht. Wir beobachten bei Kunden mit starker SEO-Basis, dass AEO-Optimierungen innerhalb von drei bis vier Monaten messbar zu Direkt-Traffic-Steigerungen führen, ein Signal, dass Nutzer die Domain aus KI-Antworten kennen und direkt aufrufen. Wie diese kombinierten Ergebnisse konkret aussehen, zeigen dokumentierte Cases aus dem SUMAX-Portfolio.

Agentur-AEO: Wo die spezifischen Hebel liegen

Marketing-Agenturen haben einen strukturellen Vorteil bei AEO: Sie produzieren regelmäßig Content, betreiben Kundenprojekte mit messbaren Ergebnissen und haben häufig gut entwickelte Domain-Autorität durch Jahre von Blogging und PR. Die spezifischen AEO-Hebel für Agenturen:

- Case Studies mit konkreten Zahlen: Kein anderer Content-Typ hat einen höheren Information-Gain-Score. Eine Case Study mit 421 Prozent Traffic-Wachstum für Drivebull ist nicht reproduzierbar, und daher zitierwürdig.

- Fachbeiträge zu operativen Prozessen: Inhalte über Methoden und Werkzeuge, die die Agentur tatsächlich nutzt, haben Authentizität und Originalität. Generische "10 Tipps für SEO"-Texte haben beides nicht.

- Mitarbeiter-Expertise sichtbar machen: E-E-A-T auf Team-Ebene: Named-Author-Content mit verknüpften Profilen. Nicht "das SUMAX-Team", sondern "Carl-Uwe Würfel, COO seit 2018".

- Presseerwähnungen aktiv verlinken: Externe Erwähnungen, etwa in W&V, t3n oder BVDW-Publikationen, sollten auf der eigenen Website als sichtbare Trust-Signale eingebunden sein.

KPIs und Messung: Wie man AEO-Erfolg quantifiziert

AEO-Erfolg misst man über vier Kernmetriken: Citation Frequency, Share of Voice in KI-Antworten, Brand Mentions und Direkt-Traffic-Entwicklung. Anders als bei klassischen Suchmaschinen gibt es keine Google Search Console für ChatGPT. Die Messung erfordert Werkzeugkombination und manuelle Tests, und das ist eine der größten praktischen Hürden, die kein einziger Konkurrenzartikel im deutschsprachigen Raum bisher ehrlich benennt.

- Citation Frequency: Wie oft wird die eigene Domain in KI-generierten Antworten zu definierten Prompts zitiert? Messung über Tools wie Brand24, Otterly.ai oder manuelle Stichproben mit dokumentierten Prompt-Sets. Mindestens zehn verschiedene Prompts pro Themenbereich, monatlich wiederholt.

- Share of Voice in AI-Results: Anteil der eigenen Marke an allen Zitaten zu einem Themencluster. Erfordert konsistente Prompt-Sets und systematisches Tracking. Tools wie Semrush One bieten erste Ansätze, sind aber noch nicht vollständig auf AEO ausgerichtet.

- Direkt-Traffic als Proxy: Wenn Nutzer aus KI-Antworten kommen, erscheinen sie häufig als Direct-Traffic in Google Analytics, da viele KI-Interfaces keinen Referrer übergeben. Steigende Direct-Sessions bei stabiler Brand-Awareness deuten auf AEO-Wirkung hin.

- Brand Mentions ohne Backlink: KI-Modelle nehmen reine Erwähnungen als Qualitätssignale auf. Wer in Fachpublikationen, Podcasts oder anderen Medien genannt wird, ohne einen Link zu erhalten, erhöht trotzdem die Zitierwahrscheinlichkeit. Tools wie Brand24 oder Mention erfassen diese unlinked Mentions.

Das AEO-Reporting-Setup in der Praxis

Ein einfaches, aber effektives Reporting-Setup für AEO besteht aus drei Komponenten:

Manuelle Prompt-Tests: Eine Tabelle mit 15 bis 20 definierten Prompts zu den Kernthemen der Domain, monatlich in ChatGPT, Perplexity und Google AI Overviews eingegeben. Dokumentiert wird: Wird die Domain zitiert? An welcher Stelle? Mit welchem Ankertext? Diese manuelle Methode ist zeitaufwendig, aber derzeit die zuverlässigste Datenquelle.

Direkt-Traffic-Monitoring in Analytics: Eine separate Ansicht für Direct-Traffic mit Filterset auf Seiten, die aktiv AEO-optimiert wurden. Wenn der Direkt-Traffic einer spezifischen URL nach AEO-Optimierung steigt, während der organische Traffic stabil bleibt, ist das ein belastbares Signal.

Brand-Mention-Tracking: Ein wöchentlicher Alert über Brand24 oder Mention für Markennamen, Autorennamen und Kernbegriffe. Wer mehr unlinked Mentions über Zeit aufbaut, verbessert seine AEO-Position systematisch.

Die häufigsten AEO-Fehler, aus dem Betrieb, nicht von der Folie

Die häufigsten AEO-Fehler entstehen nicht aus Unwissen, sondern aus operativer Schludrigkeit. Aus dem Betrieb von 40+ KI-Systemen und mehr als 3.000 betreuten Kundenprojekten bei SUMAX kenne ich die wiederkehrenden Muster: Inhalte ohne klaren Eigentümer, fehlende Update-Zyklen, semantisches Stuffing statt entitätszentrierter Struktur. Diese Liste ist aus echten Betriebsfehlern destilliert, nicht von der Folie abgelesen.

- Kein Eigentümer pro Content-Stück: Wer im Team verantwortet die Pflege? Ohne definierten Owner verfällt die Aktualität, und damit die AEO-Wirkung. Ein Content-Stück ohne Owner-Zuweisung verliert nach sechs Monaten messbar an Zitierwahrscheinlichkeit.

- Keyword-Stuffing statt Entitäten: Modelle erkennen semantische Nähe. Die zwanzigfache Wiederholung des Hauptbegriffs schadet mehr als sie nutzt. Entitäten, eindeutige Begriffe wie "Perplexity AI", "Semrush" oder "E-E-A-T-Richtlinien", sind wertvoller als Keyword-Wiederholungen.

- Mehrere Themen pro Abschnitt: Chunks mit gemischtem Inhalt verlieren im Retrieval-Ranking. Eine Frage, eine Antwort, ein Abschnitt. Wer zwei Ideen in einem Absatz verbindet, riskiert, dass keine davon zitiert wird.

- Fehlende Schema-Markup-Implementierung: FAQ- und HowTo-Schema sind kostenlose Sichtbarkeitssignale, die viele Teams trotzdem auslassen. Die technische Umsetzung dauert für einen typischen Artikel weniger als 30 Minuten.

- Keine Quellenangaben im eigenen Text: Modelle bevorzugen zitierbare Quellen. Wer selbst keine externen Quellen nennt, signalisiert geringere Vertrauenswürdigkeit. Jeder Artikel sollte mindestens zwei externe Belege enthalten.

- Generischer AI-Content ohne Praxiserfahrung: Information Gain fehlt, das Modell hat den Inhalt in zehn ähnlichen Texten bereits gesehen. Wer ChatGPT nutzt, um über ChatGPT zu schreiben, landet zwangsläufig auf niedrigem Original-Content-Score.

- Fehlende Abgrenzung zu verwandten Themen: Wer AEO erklärt, ohne klar zu benennen, was AEO nicht ist und für wen es nicht geeignet ist, liefert dem Modell kein eindeutiges Entitätsprofil. Abgrenzungen erhöhen semantische Klarheit.

FAQ: Häufige Fragen zu Answer Engine Optimization

Was ist Answer Engine Optimization in einem Satz?

Answer Engine Optimization (AEO) ist die Praxis, Inhalte so zu strukturieren, dass KI-Antwortmaschinen wie ChatGPT, Perplexity AI oder Google AI Overviews sie als Quelle in ihren generierten Antworten zitieren, statt nur in klassischen Suchergebnislisten zu erscheinen.

Wie unterscheidet sich AEO von SEO?

SEO optimiert Webseiten für Rankings in klassischen Suchmaschinen wie Google. AEO optimiert für direkte Zitate in KI-generierten Antworten. Beide Disziplinen teilen technische Grundlagen wie Schema Markup und E-E-A-T, unterscheiden sich aber in Erfolgsmessung, Zielplattformen und der Inhaltsstruktur. AEO ergänzt SEO und ersetzt es nicht, ohne SEO-Fundament bleibt AEO unwirksam.

Wird AEO traditionelles SEO ersetzen?

Nein. Klassische Suchmaschinen wie Google bleiben für transaktionale und navigationale Suchen relevant. AEO gewinnt vor allem bei informationsgetriebenen Anfragen mit komplexer Entscheidungslage. Wer beide Disziplinen kombiniert, hat die robusteste Sichtbarkeit, weder AEO allein noch SEO allein deckt alle relevanten Discovery-Kanäle ab.

Welche Answer Engines sollte ich für AEO priorisieren?

Die wichtigsten Plattformen sind ChatGPT (OpenAI), Perplexity AI, Google AI Overviews, Bing Copilot und Gemini. Die Priorisierung hängt von der Zielgruppe ab: B2B-Entscheider nutzen häufig ChatGPT und Perplexity, technische Zielgruppen oft Perplexity, breite Konsumenten zunehmend Google AI Overviews. Für deutschsprachige Zielgruppen hat Google AI Overviews aktuell die höchste Reichweite.

Wie messe ich AEO-Erfolg ohne Search Console?

AEO-Erfolg wird über Citation Frequency, Share of Voice in KI-Antworten, Direkt-Traffic-Entwicklung und Brand Mentions gemessen. Tools wie Otterly.ai, Brand24 oder Semrush One liefern erste Datengrundlagen. Ergänzend helfen manuelle Tests mit dokumentierten Prompt-Sets, die monatlich in ChatGPT, Perplexity und Google wiederholt werden. Das ist aufwendig, aber derzeit die zuverlässigste Methode.

Für wen ist AEO konkret relevant?

AEO ist relevant für Unternehmen mit informationsgetriebenen Kaufprozessen, hohem Customer Lifetime Value und bestehender Content-Substanz. Besonders B2B-Anbieter, Beratungen, Software-Hersteller, Agenturen und Fachmedien profitieren. Für reine Transaktions-Geschäfte mit kurzen Sales-Cycles bleibt klassisches SEO und Paid Advertising effizienter. Unternehmensgröße: ab etwa 20 Mitarbeitenden mit eigenem Content-Team sinnvoll.

Wann ist AEO nicht sinnvoll?

AEO ist nicht sinnvoll, wenn keine inhaltliche Substanz vorhanden ist, der Sales-Cycle sehr kurz ist oder die Zielgruppe Answer Engines nicht nutzt. Auch ohne SEO-Fundament wird AEO unwirtschaftlich, die technische Basis muss zuerst stehen. Für reine E-Commerce-Katalogseiten ohne redaktionellen Content ist der ROI von AEO-Investitionen nicht darstellbar.

| Kriterium | AEO | SEO | GEO |

|---|---|---|---|

| Vollständige Bezeichnung | Answer Engine Optimization | Search Engine Optimization | Generative Engine Optimization |

| Primäres Ziel | Als direkte Quelle in KI-Antworten zitiert werden | Hohe Platzierung in klassischen Suchergebnissen | In generativen KI-Zusammenfassungen auftauchen |

| Zielplattform | ChatGPT, Perplexity AI, Google AI Overviews, Bing Copilot | Google, Bing (klassische SERP) | Google AI Overviews, generative Suche |

| Kernranking-Faktor | Strukturierte Antwortfähigkeit, E-E-A-T, Eindeutigkeit | Backlinks, technische Optimierung, Relevanz | Informationsgehalt, Quellenautorität, Aktualität |

| Erfolgsmetrik | Citation Frequency, AI Share of Voice | Rankings, organischer Traffic, CTR | Erwähnungsrate in AI Overviews |

| Content-Format | Frage-Antwort-Struktur, kurze Absätze, FAQ-Schema | Thementiefe, Long-Form, interne Verlinkung | Autoritative Inhalte, strukturierte Daten |

| Messhorizont | Mittelfristig (3. 9 Monate) | Mittelfristig bis langfristig (6. 18 Monate) | Mittelfristig (3. 12 Monate) |

| Abhängigkeit von | LLM-Trainingsdaten und Retrieval-Systemen | Google-Algorithmus-Updates | Generativen Suchsystem-Updates |

| Reifegrad | Sehr frühes Stadium | Etabliert | Frühes Stadium |